[ad_1]

Xbox a publié son tout premier rapport sur la transparence numérique, offrant un aperçu du travail que ses équipes de communauté et de modération ont accompli au cours des six derniers mois au nom de la sécurité des joueurs – y compris les nouvelles qu’elle a pris des mesures sur 7,3 millions de violations de la communauté pendant cette période.

Microsoft annonce la publication de son premier rapport sur la transparence numérique dans le cadre de son « engagement de longue date en faveur de la sécurité en ligne », dans le but de publier un rapport mis à jour tous les six mois afin de pouvoir aborder les principaux enseignements et faire davantage pour « aider les gens à comprendre comment jouer un rôle positif dans la communauté Xbox. »

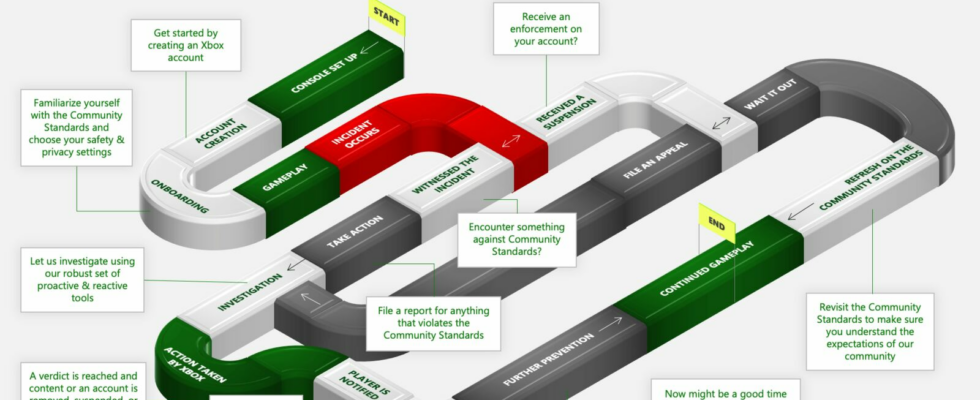

Une grande partie du document est consacrée à réitérer les divers outils et processus dont Microsoft et les joueurs Xbox disposent pour garantir la sécurité des utilisateurs et le respect des directives de la communauté, allant du contrôle parental au signalement.

Cependant, la seconde moitié du rapport de Microsoft donne des détails plus spécifiques sur ses actions au cours des six derniers mois, en ventilant le nombre de rapports de joueurs par rapport au nombre d’applications (c’est-à-dire les cas où le contenu est supprimé, les comptes sont suspendus, ou les deux ).

Au total, Microsoft affirme avoir reçu 33 millions de rapports de joueurs entre le 1er janvier et le 30 juin de cette année, dont 14,16 millions (43 %) liés au comportement des joueurs, 15,23 millions (46 %) axés sur les communications et 3,68 millions (11 %) basés sur sur le contenu généré par l’utilisateur.

Parmi ces rapports, 2,53 millions ont abouti à ce que Microsoft appelle des mises en application réactives, et 4,78 millions de mises en application supplémentaires ont été effectuées de manière proactive (c’est-à-dire à l’aide de « technologies de protection ajoutant des processus » avant qu’un problème ne soit soulevé par un joueur), ce qui porte le nombre total d’exécutions jusqu’à 7.31M. Notamment, 4,33 millions (57 % de toutes les mesures d’application) étaient liées à des tricheries et à des comptes non authentiques, sur la base d’activités détectées avant les rapports des joueurs.

Le rapport de transparence complète donne un aperçu intéressant des défis de modération auxquels une plate-forme comme Xbox est confrontée, ainsi que des mesures que Microsoft a prises jusqu’à présent pour les combattre.

[ad_2]

Source link -51