[ad_1]

KYIV, Ukraine (AP) – Les progrès des drones en Ukraine ont accéléré une tendance technologique attendue depuis longtemps qui pourrait bientôt amener les premiers robots de combat entièrement autonomes au monde sur le champ de bataille, inaugurant une nouvelle ère de guerre.

Plus la guerre dure, plus il est probable que des drones seront utilisés pour identifier, sélectionner et attaquer des cibles sans l’aide d’humains, selon des analystes militaires, des combattants et des chercheurs en intelligence artificielle.

Cela marquerait une révolution dans la technologie militaire aussi profonde que l’introduction de la mitrailleuse. L’Ukraine dispose déjà de drones d’attaque semi-autonomes et d’armes anti-drones dotées d’IA. La Russie prétend également posséder des armes à intelligence artificielle, bien que ces affirmations ne soient pas prouvées. Mais il n’y a aucun cas confirmé d’une nation mettant en combat des robots qui ont tué entièrement par eux-mêmes.

Les experts disent que ce n’est peut-être qu’une question de temps avant que la Russie ou l’Ukraine, ou les deux, ne les déploient.

« De nombreux États développent cette technologie », a déclaré Zachary Kallenborn, analyste de l’innovation en matière d’armes à l’Université George Mason. « De toute évidence, ce n’est pas si difficile. »

Le sentiment d’inévitabilité s’étend aux militants, qui ont essayé pendant des années d’interdire les drones tueurs mais croient maintenant qu’ils doivent se contenter d’essayer de restreindre l’utilisation offensive des armes.

Le ministre ukrainien de la transformation numérique, Mykhailo Fedorov, convient que les drones tueurs entièrement autonomes sont « une prochaine étape logique et inévitable » dans le développement des armes. Il a déclaré que l’Ukraine faisait « beaucoup de R&D dans cette direction ».

« Je pense que le potentiel pour cela est grand dans les six prochains mois », a déclaré Fedorov à l’Associated Press dans une récente interview.

Le lieutenant-colonel ukrainien Yaroslav Honchar, co-fondateur de l’organisation à but non lucratif d’innovation en matière de drones de combat Aerorozvidka, a déclaré dans une récente interview près du front que les combattants humains ne peuvent tout simplement pas traiter les informations et prendre des décisions aussi rapidement que les machines.

Les chefs militaires ukrainiens interdisent actuellement l’utilisation d’armes létales totalement indépendantes, bien que cela puisse changer, a-t-il déclaré.

« Nous n’avons pas encore franchi cette ligne – et je dis ‘encore’ parce que je ne sais pas ce qui se passera dans le futur. » a déclaré Honchar, dont le groupe a été le fer de lance de l’innovation en matière de drones en Ukraine, convertissant des drones commerciaux bon marché en armes mortelles.

La Russie pourrait obtenir une IA autonome de l’Iran ou d’ailleurs. Les drones explosifs à longue portée Shahed-136 fournis par l’Iran ont paralysé les centrales électriques ukrainiennes et terrorisé les civils, mais ne sont pas particulièrement intelligents. L’Iran a d’autres drones dans son arsenal en évolution qui, selon lui, sont équipés d’IA.

Sans trop de problèmes, l’Ukraine pourrait rendre ses drones armés semi-autonomes totalement indépendants afin de mieux survivre au brouillage du champ de bataille, selon leurs fabricants occidentaux.

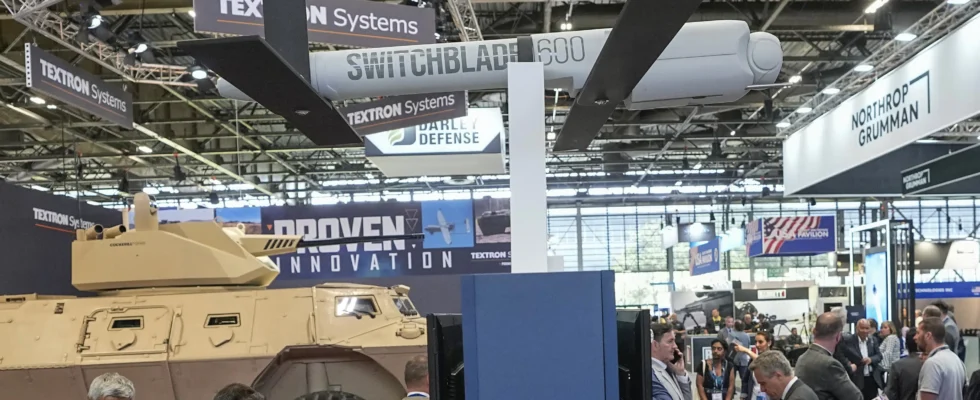

Ces drones incluent le Switchblade 600 fabriqué aux États-Unis et le Warmate polonais, qui nécessitent actuellement qu’un humain choisisse des cibles plutôt qu’un flux vidéo en direct. L’IA termine le travail. Les drones, techniquement connus sous le nom de «munitions flânantes», peuvent planer pendant des minutes au-dessus d’une cible, en attendant un tir net.

« La technologie permettant de réaliser une mission entièrement autonome avec Switchblade existe à peu près aujourd’hui », a déclaré Wahid Nawabi, PDG d’AeroVironment, son créateur. Cela nécessitera un changement de politique – pour retirer l’humain de la boucle décisionnelle – qu’il estime être dans trois ans.

Les drones peuvent déjà reconnaître des cibles telles que des véhicules blindés à l’aide d’images cataloguées. Mais il y a un désaccord sur la question de savoir si la technologie est suffisamment fiable pour garantir que les machines ne se trompent pas et ne tuent pas des non-combattants.

L’AP a demandé aux ministères de la Défense de l’Ukraine et de la Russie s’ils avaient utilisé des armes autonomes de manière offensive – et s’ils accepteraient de ne pas les utiliser si l’autre partie acceptait de la même manière. Aucun des deux n’a répondu.

Si l’un ou l’autre côté devait attaquer avec une IA complète, ce ne serait peut-être même pas une première.

Un rapport de l’ONU peu concluant l’année dernière a suggéré que les robots tueurs ont fait leurs débuts dans le conflit interne de la Libye en 2020, lorsque des drones Kargu-2 de fabrication turque en mode entièrement automatique ont tué un nombre indéterminé de combattants.

Un porte-parole de STM, le fabricant, a déclaré que le rapport était basé sur des informations « spéculatives, non vérifiées » et « ne devrait pas être pris au sérieux ». Il a dit à l’AP que le Kargu-2 ne peut pas attaquer une cible tant que l’opérateur ne lui a pas dit de le faire.

L’IA entièrement autonome aide déjà à défendre l’Ukraine. Fortem Technologies, basée dans l’Utah, a fourni à l’armée ukrainienne des systèmes de chasse aux drones qui combinent de petits radars et des véhicules aériens sans pilote, tous deux alimentés par l’IA. Les radars sont conçus pour identifier les drones ennemis, que les drones désactivent ensuite en leur lançant des filets, le tout sans assistance humaine.

Le nombre de drones dotés d’IA ne cesse de croître. Israël les exporte depuis des décennies. Sa harpie qui tue les radars peut survoler un radar anti-aérien jusqu’à neuf heures en attendant qu’il se mette sous tension.

D’autres exemples incluent l’hélicoptère armé sans pilote Blowfish-3 de Pékin. La Russie travaille sur un drone IA sous-marin à pointe nucléaire appelé Poséidon. Les Néerlandais testent actuellement un robot terrestre avec une mitrailleuse de calibre .50.

Honchar pense que la Russie, dont les attaques contre des civils ukrainiens ont montré peu de respect pour le droit international, aurait déjà utilisé des drones tueurs autonomes si le Kremlin en avait.

« Je ne pense pas qu’ils auraient des scrupules », a convenu Adam Bartosiewicz, vice-président de WB Group, qui fabrique le Warmate.

L’IA est une priorité pour la Russie. Le président Vladimir Poutine a déclaré en 2017 que celui qui dominerait cette technologie dominerait le monde. Dans un discours du 21 décembre, il a exprimé sa confiance dans la capacité de l’industrie russe de l’armement à intégrer l’IA dans les machines de guerre, soulignant que « les systèmes d’armes les plus efficaces sont ceux qui fonctionnent rapidement et pratiquement en mode automatique ». Les responsables russes affirment déjà que leur drone Lancet peut fonctionner en toute autonomie.

« Il ne sera pas facile de savoir si et quand la Russie franchira cette ligne », a déclaré Gregory C. Allen, ancien directeur de la stratégie et de la politique. au Centre conjoint d’intelligence artificielle du Pentagone.

Faire passer un drone du pilotage à distance à l’autonomie complète peut ne pas être perceptible. À ce jour, les drones capables de fonctionner dans les deux modes ont mieux fonctionné lorsqu’ils sont pilotés par un humain, a déclaré Allen.

La technologie n’est pas particulièrement compliquée, a déclaré Stuart Russell, professeur à l’Université de Californie-Berkeley, un chercheur de haut niveau en IA. Au milieu des années 2010, des collègues qu’il a interrogés ont convenu que des étudiants diplômés pourraient, en un seul trimestre, produire un drone autonome « capable de trouver et de tuer un individu, disons, à l’intérieur d’un bâtiment », a-t-il déclaré.

Un effort visant à établir des règles de base internationales pour les drones militaires a jusqu’à présent été infructueux. Neuf ans de pourparlers informels des Nations Unies à Genève n’ont guère progressé, les grandes puissances, dont les États-Unis et la Russie, s’opposant à une interdiction. La dernière session, en décembre, s’est terminée sans nouveau cycle prévu.

Les décideurs politiques de Washington disent qu’ils n’accepteront pas une interdiction car on ne peut pas faire confiance à leurs rivaux développant des drones pour les utiliser de manière éthique.

Toby Walsh, un universitaire australien qui, comme Russell, fait campagne contre les robots tueurs, espère parvenir à un consensus sur certaines limites, notamment l’interdiction des systèmes qui utilisent la reconnaissance faciale et d’autres données pour identifier ou attaquer des individus ou des catégories de personnes.

« Si nous ne faisons pas attention, elles vont proliférer beaucoup plus facilement que les armes nucléaires », a déclaré Walsh, auteur de « Machines Behaving Badly ». « Si vous pouvez faire en sorte qu’un robot tue une personne, vous pouvez le faire en tuer mille. »

Les scientifiques s’inquiètent également de la réutilisation des armes IA par des terroristes. Dans un scénario redouté, l’armée américaine dépense des centaines de millions pour écrire du code pour alimenter des drones tueurs. Ensuite, il est volé et copié, donnant ainsi aux terroristes la même arme.

Le public mondial est concerné. Une enquête Ipsos réalisée pour Human Rights Watch en 2019 a révélé que 61 % des adultes dans 26 pays s’opposer à l’utilisation de systèmes d’armes létaux autonomes.

À ce jour, le Pentagone n’a ni clairement défini « l’arme autonome » ni autorisé une seule de ces armes à utiliser par les troupes américaines, a déclaré Allen, l’ancien responsable du ministère de la Défense. Tout système proposé doit être approuvé par le président des chefs d’état-major interarmées et deux sous-secrétaires.

Cela n’empêche pas le développement d’armes à travers les projets américains sont en cours à la Defense Advanced Research Projects Agencylaboratoires militaires, institutions académiques et dans le secteur privé.

Le Pentagone a mis l’accent sur l’utilisation de l’IA pour augmenter les guerriers humains. L’armée de l’air étudie les moyens de jumeler des pilotes avec des ailiers de drones. Un promoteur de l’idée, l’ancien secrétaire adjoint à la Défense, Robert O. Work, a déclaré dans un rapport le mois dernier qu’il « serait fou de ne pas passer à un système autonome » une fois que les systèmes activés par l’IA surpasseraient les humains – un seuil qui, selon lui, a été franchi. en 2015, lorsque la vision par ordinateur a éclipsé celle des humains.

Les humains ont déjà été repoussés dans certains systèmes défensifs. Le bouclier antimissile Iron Dome d’Israël est autorisé à ouvrir le feu automatiquement, bien qu’il soit censé être surveillé par une personne qui peut intervenir si le système poursuit la mauvaise cible.

Plusieurs pays, et chaque branche de l’armée américaine, développent des drones qui peuvent attaquer en essaims synchronisés mortels, selon Kallenborn, le chercheur de George Mason.

Alors, les guerres futures deviendront-elles un combat jusqu’au dernier drone ?

C’est ce que Poutine avait prédit lors d’une conversation télévisée en 2017 avec des étudiants en ingénierie : « Lorsque les drones d’une partie sont détruits par les drones d’une autre, elle n’aura d’autre choix que de se rendre ».

___

Frank Bajak a rapporté de Boston. Les journalistes d’Associated Press Tara Copp à Washington, Garance Burke à San Francisco et Suzan Fraser en Turquie ont contribué à ce rapport.

___

Suivez la couverture de la guerre par l’AP sur https://apnews.com/hub/russia-ukraine

[ad_2]

Source link -39