[ad_1]

No besoin d’histoires plus effrayantes sur l’automatisation imminente du futur. Artistes, designers, photographes, auteurs, acteurs et musiciens voient peu d’humour dans les blagues sur les programmes d’IA qui feront un jour leur travail pour moins d’argent. Cette aube sombre est là, disent-ils.

De vastes quantités de production imaginative, de travail réalisé par des personnes dans le type d’emplois autrefois censés être protégés de la menace de la technologie, ont déjà été capturées sur le Web, pour être adaptées, fusionnées et rendues anonymes par des algorithmes à des fins commerciales. Mais tout comme GPT-4, la version améliorée du moteur de texte génératif AI, a été fièrement dévoilée la semaine dernière, les artistes, les écrivains et les régulateurs ont commencé à riposter sérieusement.

« Les bibliothèques d’images sont récupérées pour le contenu et d’énormes ensembles de données sont amassés en ce moment », déclare Isabelle Doran, responsable de l’Association des photographes. « Donc, si nous voulons assurer l’appréciation de la créativité humaine, nous avons besoin de nouvelles façons de tracer le contenu et de la protection de lois plus intelligentes. »

Campagnes collectives, procès, règles internationales et hacks informatiques se déploient à toute allure au nom des industries créatives dans le but, sinon de gagner la bataille, du moins de « rager, rager contre la mort de la lumière », dans le paroles du poète gallois Dylan Thomas.

La poésie est peut-être encore un problème difficile à résoudre pour l’IA, mais les photographes et les designers sont parmi les premiers à faire face à une véritable menace pour leurs moyens de subsistance. Les logiciels génératifs peuvent produire des images d’une simple pression sur un bouton, tandis que des sites comme le populaire NightCafe créent des illustrations « originales » dérivées de données en réponse à quelques simples invites verbales. La première ligne de défense est un mouvement croissant d’artistes visuels et d’agences d’image qui « renoncent » désormais à ce que leur travail soit exploité par un logiciel d’IA, un processus appelé « formation aux données ». En conséquence, des milliers de personnes ont affiché des pancartes « Ne pas IA » sur leurs comptes de médias sociaux et leurs galeries Web.

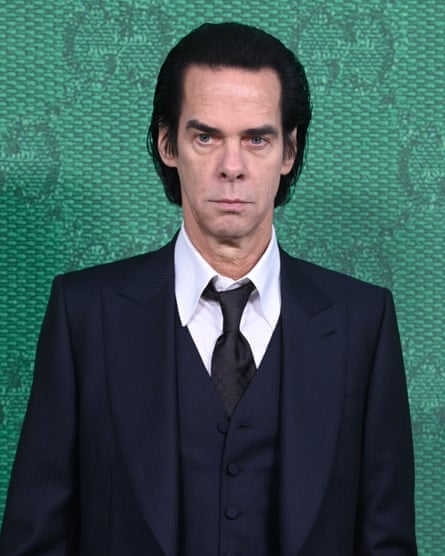

Une approximation générée par logiciel des paroles de Nick Cave a notamment attiré la colère de l’interprète plus tôt cette année. Il l’a appelé « une moquerie grotesque de ce que c’est que d’être humain ». Pas une bonne critique. Pendant ce temps, les innovations de l’IA telles que Jukebox menacent également les musiciens et les compositeurs.

Et la technologie de clonage numérique de la voix met les vrais narrateurs et acteurs au chômage. En février, un narrateur de livres audio vétéran du Texas appelé Gary Furlong a remarqué qu’Apple avait obtenu le droit « d’utiliser des fichiers de livres audio pour la formation et les modèles d’apprentissage automatique » dans l’un de ses contrats. Mais le syndicat SAG-AFTRA s’est saisi de son cas. L’agence impliquée, Findaway Voices, désormais détenue par Spotify, a depuis accepté d’appeler à un arrêt temporaire et pointe une clause de « révocation » dans ses contrats. Mais cette année, Apple a sorti ses premiers livres narrés par des algorithmes, un service que Google propose depuis deux ans.

L’inévitabilité rampante de ce nouveau défi lancé aux artistes semble injuste, même aux spectateurs. Comme le demande l’auteure britannique primée Susie Alegre, récemment victime du plagiat de l’IA : « Avons-nous vraiment besoin de trouver d’autres façons de faire les choses que les gens aiment faire de toute façon ? Des choses qui nous donnent un sentiment d’accomplissement, comme écrire un poème ? Pourquoi ne pas remplacer les choses que nous n’aimons pas faire ?

Alegre, avocat des droits de l’homme et écrivain basé à Londres, affirme que la valeur de la pensée authentique a déjà été sapée : « Si le monde va faire confiance à l’IA, à quoi bon ? Les taux de rémunération pour le travail original ont été massivement diminués. Il s’agit d’un dépouillement automatisé des actifs intellectuels. »

La vérité est que les incursions de l’IA dans le monde créatif ne font que faire la une des journaux. C’est amusant, après tout, de lire sur une chanson ou une œuvre d’art primée imaginée par ordinateur. Les récits d’innovations logicielles dans le domaine de la souscription d’assurances sont moins convaincants. Néanmoins, les efforts scientifiques pour simuler l’imagination ont toujours été à l’avant-garde de la promotion d’une meilleure IA, précisément parce que c’est si difficile à faire. Un logiciel pourrait-il vraiment produire des peintures qui attirent l’attention ou des histoires qui engagent ? Jusqu’à présent, la réponse aux deux, heureusement, est « non ». Le ton et le registre émotionnel approprié restent difficiles à falsifier.

Pourtant, la perspective de carrières créatives valables est en jeu. ChatGPT n’est que l’un des derniers produits d’IA, avec Bard de Google et Bing de Microsoft, à avoir bousculé la législation sur le droit d’auteur. Les artistes et les écrivains qui perdent face à l’IA ont tendance à parler tristement de programmes qui «crachent des ordures» et «déversent des bêtises», et d’un sentiment de «violation». Ce moment de péril créatif est arrivé avec l’énorme quantité de données désormais disponibles sur le Web pour une récolte secrète plutôt qu’en raison d’une poussée malveillante. Mais ses victimes s’alarment.

L’analyse du problème naissant en février a révélé que le travail des designers et des illustrateurs est le plus vulnérable. Des logiciels tels que Midjourney, Stable Diffusion et DALL.E 2 créent des images en quelques secondes, toutes extraites d’une banque de données de styles et de palettes de couleurs. Une plate-forme, ArtStation, aurait été tellement submergée par les mèmes anti-IA qu’elle a demandé l’étiquetage des illustrations d’IA.

À l’Association des photographes, Doran a monté une enquête pour évaluer l’ampleur de l’attaque. « Nous avons des preuves claires que les ensembles de données d’images, qui constituent la base de ces programmes commerciaux de contenu d’image génératif d’IA, consistent en des millions d’images provenant de sites Web publics prises sans autorisation ni paiement », dit-elle. Utilisant le site Have I Been Trained qui a accès à l’ensemble de données Stable Diffusion, ses membres « choqués » ont identifié leurs propres images et pleurent la perte de valeur de leur propriété intellectuelle.

après la promotion de la newsletter

Le mouvement d’opt-out se répand, avec des dizaines de millions d’œuvres et d’images exclues ces dernières semaines. Mais suivre la piste est délicat car les images sont utilisées par les clients sous des formes modifiées et les clauses d’exclusion peuvent être difficiles à trouver. De nombreux photographes signalent également que leur « style » est imité pour produire un travail moins cher. « Comme ces programmes sont conçus pour ‘apprendre automatiquement’, à quel point peuvent-ils facilement générer le style d’un photographe professionnel établi et déplacer le besoin de sa créativité humaine ? » dit Doran.

Pour Alegre, qui a découvert le mois dernier des paragraphes de son livre primé Liberté de penser étaient offerts, non crédités par ChatGPT, il y a des dangers cachés à simplement se retirer : « Cela signifie que vous êtes complètement exclu de l’histoire, et pour une femme, c’est problématique. »

Le travail d’Alegre est déjà attribué à tort à des auteurs masculins par AI, donc le retirer de l’équation aggraverait l’erreur. Les banques de données ne peuvent refléter que ce à quoi elles ont accès.

« ChatGPT a dit que je n’existais pas, bien qu’il ait cité mon travail. Outre les dommages causés à mon ego, j’existe sur Internet, donc c’était comme une violation », dit-elle.

« Plus tard, il est venu avec un synopsis assez précis de mon livre, mais a déclaré que l’auteur était un type au hasard. Et, curieusement, mon livre traite de la façon dont la désinformation déforme notre vision du monde. Le contenu de l’IA est vraiment aussi fiable que la vérification de votre horoscope. Elle aimerait voir le financement du développement de l’IA détourné vers la recherche de nouvelles protections juridiques.

Les fans d’IA pourraient bien promettre qu’elle peut nous aider à mieux comprendre l’avenir au-delà de nos limites intellectuelles. Mais pour les artistes et écrivains plagiés, il semble maintenant que le meilleur espoir est que cela enseigne à nouveau aux humains que nous devons douter et vérifier tout ce que nous voyons et lisons.

[ad_2]

Source link -9