Make this article seo compatible,Let there be subheadings for the article, be in french, create at least 700 words

Noch nie war es so einfach, täuschend echte Bilder zu erstellen. Eine Internetverbindung, ein auf künstlicher Intelligenz (KI) basierendes Tool und eine kurze Beschreibung, was auf dem Bild zu sehen sein soll: Binnen Sekunden sind fotorealistische Bilder erschaffen, die viele Nutzerinnen und Nutzer als echt wahrnehmen – und die sich dann in den sozialen Netzwerken verbreiten. Das ist vor allem dann gefährlich, wenn die per KI erstellten Fotos gezielt zur Verbreitung von Desinformation oder Diskreditierung von Personen genutzt werden. Um das bei den in diesem Jahr weltweit bevorstehenden Wahlen zu verhindern, hat das vor allem durch den Chatbot ChatGPT bekannt geworden Unternehmen OpenAI nun zahlreiche Maßnahmen angekündigt.

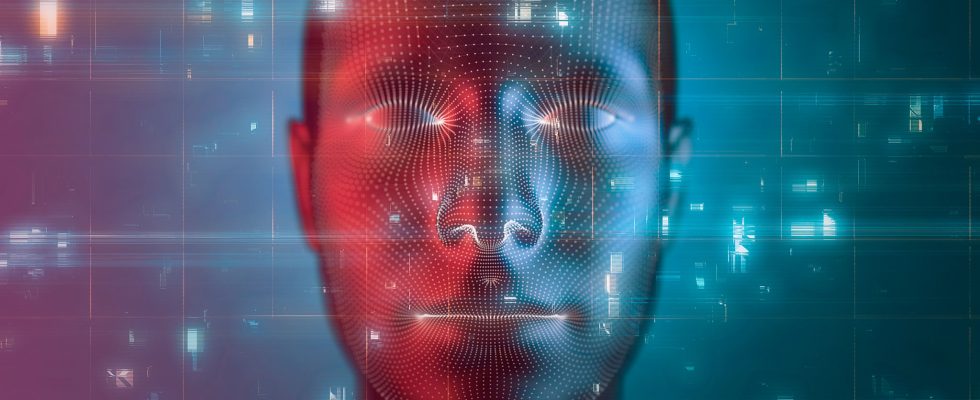

Software soll KI-Bilder erkennen

Weitere Maßnahmen zum Schutz von Wahlen

Das ist noch nicht alles, was OpenAI zum Schutz der weltweiten Wahlen vorgesehen hat: So ist es Entwicklerinnen und Entwicklern beispielsweise verboten, Chatbots zu erstellen, die sich fälschlicherweise als echte Personen wie Kandidaten oder Behörden ausgeben. Ebenso sind Anwendungen verboten, die in die Irre führen, wer wählen darf oder wo und wie gewählt wird. In den USA verweist ChatGPT bei Fragen zum Wahlablauf zudem auf eine offizielle Seite der National Association of Secretaries of State (NASS). Ähnliches will das Unternehmen auch in anderen Ländern anbieten, in denen 2024 Wahlen stattfinden. Dazu gehört neben Österreich, Großbritannien, Indien und der Türkei unter anderem auch Russland.