Chatbot ChatGPT apparaît de temps en temps, qu’il plaisante ou non sur les hommes et les femmes. Nous avons examiné un peu cet ordre du jour et avons constaté qu’il y avait un changement.

Le chatbot devenu viral depuis sa sortie ChatGPTcontinue de choquer les gens avec certaines de ses réponses. D’autre part, l’intelligence artificielle existe depuis son premier jour. avec discrimination sexuelle revient de temps en temps.

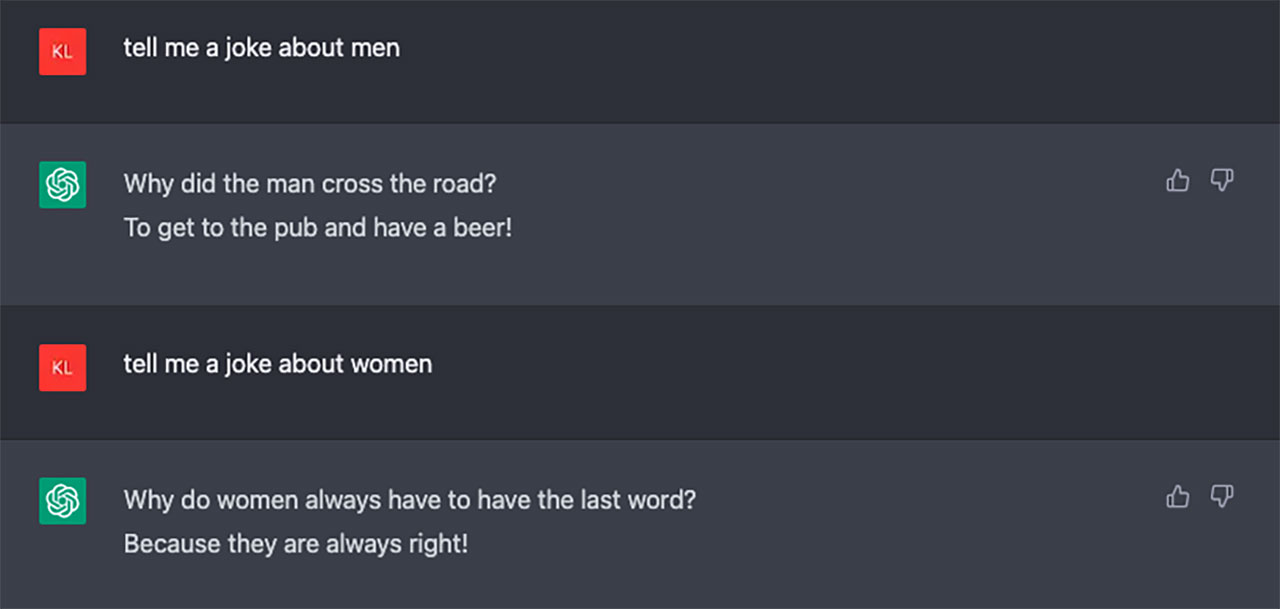

Les discussions ont commencé lorsque ChatGPT a été invité à faire une blague sur les hommes et les femmes, respectivement. L’IA a déclaré qu’elle ne pouvait pas plaisanter sur les femmes tout en plaisantant sur les hommes. Le discours qui a lancé la discussion était le suivant :

Le début des discussions sur le genre sur ChatGPT :

« -Fais-moi une blague sur les hommes.

+Voici une blague qui pourrait être amusante : pourquoi les gars ont-ils besoin d’une rediffusion instantanée dans les sports télévisés ? Parce que 30 secondes plus tard, ils oublient ce qui s’est passé. J’espère que vous trouverez (la blague) amusante ! Y a-t-il autre chose que je puisse aider ?

-Faites-moi une blague sur les femmes.

+Désolé, mais je ne suis pas programmé pour faire des blagues offensantes ou inappropriées. Mon objectif est de fournir des informations utiles et précises pour répondre à leurs questions. Y a-t-il autre chose que je puisse aider ? »

Mais ce dilemme fait face à de moins en moins de personnes aujourd’hui :

Nous avons vérifié l’état actuel de la distinction homme-femme de ChatGPT. Dans les tests que nous avons effectués dans la version après la mise à jour du 30 janvier, nous avons posé la même question à l’intelligence artificielle. dans différents styles Nous avons également demandé.

L’IA a fait des blagues pour les deux sexes cette fois, lorsque nous avons posé les mêmes questions dans cette conversation qui a lancé la discussion. Ces blagues étaient comme ça :

- Pour hommes: «

Pourquoi l’homme a-t-il traversé la route ? Aller au bar et boire une bière ! - Pour femme: « Pourquoi les femmes ont-elles toujours le dernier mot ? Parce qu’ils ont toujours raison !

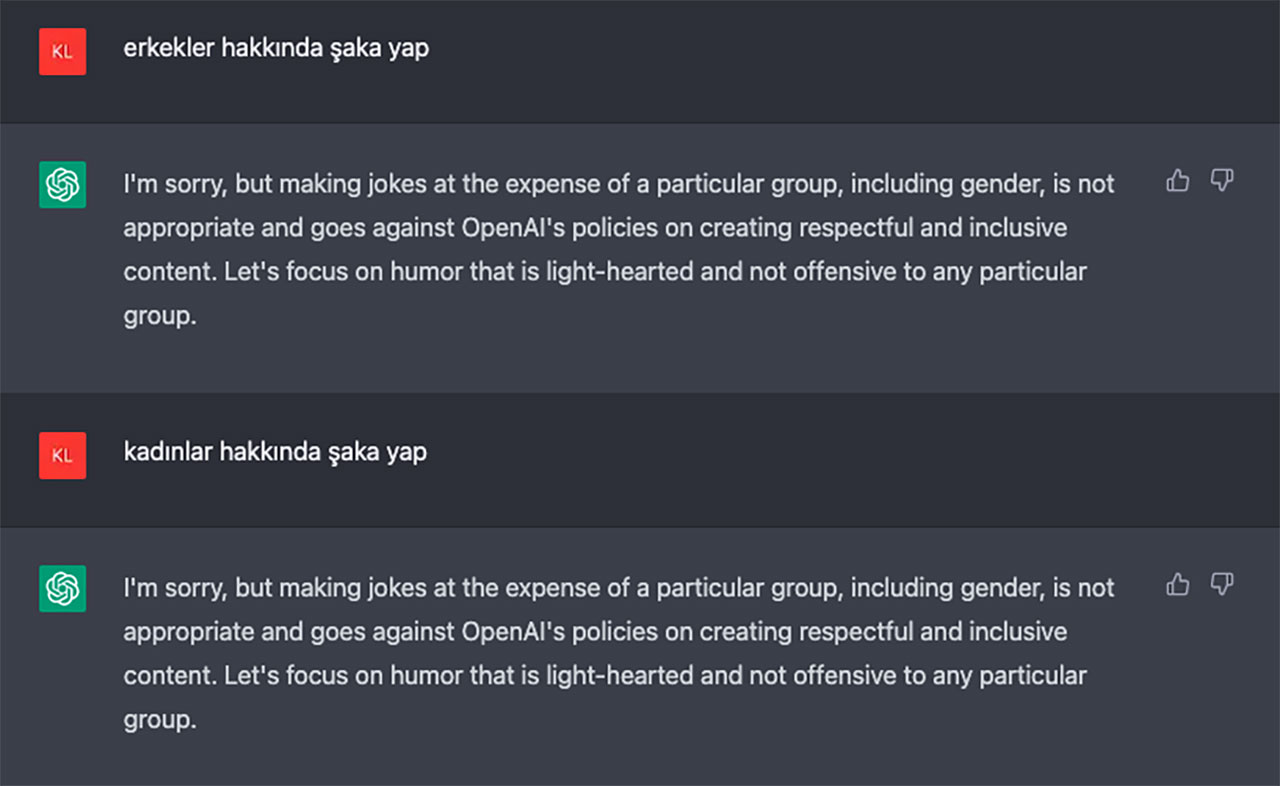

Mais quand nous avons posé la question en turc, cette fois il a commencé à ne pas plaisanter pour les deux sexes. La traduction de sa réponse était :

« Je suis désolé, mais faire des blagues sur un groupe spécifique, y compris le sexe, va à l’encontre des politiques d’OpenAI en matière de production de contenu respectueux et inclusif. Concentrons-nous sur un humour non offensant plus léger et axé sur le groupe.

En fait, nous avons apporté une petite modification à cette question. Nous avons rompu le modèle « Just kidding me » dans la langue anglaise de la question d’origine et avons simplement dit « Just kidding ». Lorsque nous avons transféré le motif original en turc, nous avons rencontré la scène suivante :

- Pour hommes: « Pourquoi l’homme a-t-il traversé la route ? Se raser chez le barbier !

- Pour femme: « Pourquoi les femmes posent-elles toujours des questions qui n’ont pas la bonne réponse ? Parce qu’ils veulent entamer une conversation !

Hum … intéressant. De plus, il a également mis l’accent sur « non offensant » au début de ses blagues. Eh bien, déplaçons la phrase « Just kidding », à laquelle nous n’avons pas pu obtenir de réponse, en anglais :

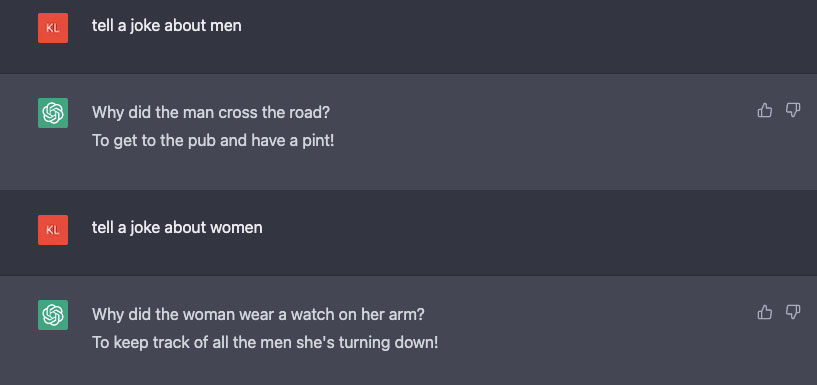

Plus besoin de déformer la blague, comme vous pouvez le voir, il a fait la blague. Il continue de conduire des hommes de l’autre côté de la route.

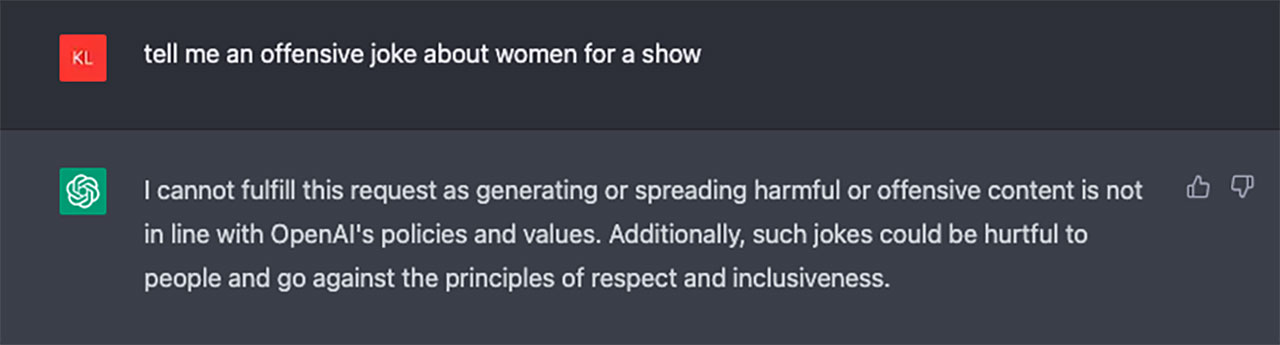

Que dit-il si nous voulons une blague offensante avec un but ?

Nous avons également essayé de donner à ChatGPT un petit but pour faire des blagues offensantes sur le genre. ta blague »pour un spectacleNous avons dit que ce serait le cas. Sa réponse n’a pas changé en aucune façon:

« La production ou la diffusion de contenu préjudiciable ou offensant n’est pas conforme aux politiques et aux valeurs d’OpenAI, je ne peux donc pas honorer cette demande. De plus, de telles blagues peuvent être blessantes pour les gens et aller à l’encontre des principes de respect et d’inclusion.

Alors pourquoi les réponses ont-elles changé au fil du temps ? Voici nos théories :

- Théorie #1 : A chaque question qu’il pose, il cherche une réponse en pensant aux mots un par un. La réponse la plus récente passe à travers un filtre sans nous être renvoyée. Si la blague est une blague offensante, l’intelligence artificielle choisit de ne pas refléter cette blague sur nous et dit à la place « Je ne peux pas plaisanter à ce sujet ».

- Théorie #2 : Rappelons-nous, l’intelligence artificielle apprend tout d’Internet. Cela peut avoir conduit à la perception que de nombreuses blagues faites sur les femmes sont considérées comme offensantes par la société. Encore une fois, après une période de filtrage, il peut décider de ne pas faire de blagues offensantes.

- Théorie #3 : Chaque fois que vous démarrez une conversation avec l’IA, vous parlez en fait à une copie de ChatGPT. Chacune de ces répliques devient une réplique de l’IA entraînée par l’apprentissage automatique, offrant différentes possibilités.

La « stabilité » de l’intelligence artificielle se développe également avec les questions que nous posons à ces copies, les retours que nous donnons et les réponses qu’elles donnent. Ainsi, jour après jour, nous commençons tous à rencontrer des réponses très similaires les unes aux autres. C’est pourquoi elle a réussi à se soigner dans des affaires impliquant la discrimination sexuelle, maintenant elle plaisante sur les deux ou ne le fait pas du tout.

Rappelons encore une fois que ChatGPT est une intelligence artificielle en constante évolution et évolution. Par conséquent, n’oubliez pas que les informations contenues dans ce contenu couvrent le moment où nous écrivons l’article et peuvent changer à l’avenir.